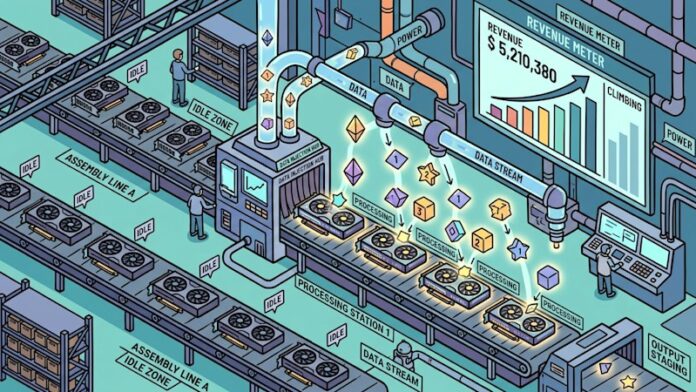

Současné prostředí umělé inteligence je charakterizováno obdobími ztraceného potenciálu. Clustery GPU, páteř strojového učení, jsou často nečinné mezi iteracemi školení nebo při změně pracovní zátěže, ale operátorům nadále vznikají náklady na energii a chlazení. FriendliAI, kterou založil výzkumník stojící za široce používanou technikou kontinuálního dávkování, spouští InferenceSense, platformu navrženou ke zpeněžení dříve promarněné kapacity. Místo toho, aby výkonný hardware mohl nečinně pracovat, InferenceSense umožňuje operátorům neo-cloud prodávat přístup k nevyužitým cyklům GPU pro úlohy odvození AI a sdílet příjmy v reálném čase.

Hlavní problém: Neefektivní využívání zdrojů

GPU clustery jsou ze své podstaty neefektivní. Školicí úkoly jsou dokončeny, poptávka kolísá a drahé vybavení zůstává nečinné, zatímco se hromadí fixní náklady. Existují spotové trhy s GPU, ale ty vyžadují, aby si poskytovatelé cloudu pronajímali kapacitu, přičemž technickou zátěž a optimalizaci inferenčního zásobníku přenechávají koncovému uživateli. Přístup FriendliAI je zásadně odlišný: umožňuje operátorům přímo zpeněžit nečinná GPU spuštěním inferenčních úloh. Obchází tak tradiční modely pronájmu a otevírá nový zdroj příjmů.

Kontinuální dávkové zpracování: Základ efektivity

Technologie, která stojí za InferenceSense, je výsledkem práce Byung-Gon Chuna, profesora na Soulské národní univerzitě, jehož výzkum kontinuálního dávkového procesu způsobil revoluci v odvozování AI. Jeho dokument z roku 2020, Orca, představil metodu dynamického zpracování, která se vyhýbá čekání na plné pakety před provedením požadavků. Tato technika, která je nyní průmyslovým standardem a je implementována v populárním inferenčním enginu vLLM, maximalizuje propustnost.

Stěžejní inovace společnosti Chun se nyní používá k vyřešení problému nedostatečného využití GPU. Cílem je naplnit nečinné cykly placenou pracovní zátěží, optimalizovat propustnost tokenů a sdílet výnosy s operátorem.

Jak InferenceSense funguje: Bezproblémová integrace

InferenceSense se integruje přímo se stávající infrastrukturou Kubernetes, kterou většina operátorů neo-cloud již používá pro orchestraci zdrojů. Operátoři přidělují fondy GPU do clusteru spravovaného FriendliAI, definují dostupnost a podmínky zrušení. Když se GPU nepoužívají, platforma spouští izolované kontejnery, které slouží k vyvození úloh pro modely s otevřenou váhou, jako jsou DeepSeek, Qwen a Kimi.

Proces je navržen tak, aby byl bezproblémový: když operátor plánovač potřebuje hardware, pracovní zátěže jsou přerušeny během několika sekund. FriendliAI zpracovává agregaci poptávky prostřednictvím přímých klientů a agregátorů, jako je OpenRouter, a poskytuje tak neustálý tok úkolů. Řídicí panely v reálném čase poskytují operátorům transparentnost ohledně použití modelu, zpracování tokenů a generovaných příjmů.

Propustnost tokenů vs. Raw Power: Klíčový rozdíl

Tradiční spotové trhy s GPU zpeněžují hrubou energii. InferenceSense však zpeněžuje propustnost tokenů, což znamená, že operátoři vydělávají peníze na základě skutečného zpracování AI, nikoli pouze nečinného hardwaru. FriendliAI tvrdí, že jeho engine poskytuje dvojnásobnou až trojnásobnou propustnost standardních nasazení vLLM, a to díky vlastnímu zásobníku C++ a proprietárním jádrům GPU, která obcházejí knihovnu cuDNN Nvidia.

Tato zvýšená efektivita se přímo promítá do vyšších příjmů za nevyužitý cyklus. Operátoři mohou vydělat více tím, že zaplní čas nečinnosti infertem, než pouhým pronájmem hrubé kapacity.

Důsledky pro AI a inženýry optimalizace nákladů

Pro inženýry AI by nástup platforem jako InferenceSense mohl změnit ekonomiku inference. Protože neo-cloudy zpeněžují nevyužitou kapacitu, mohou mít motivaci snížit ceny tokenů, aby zůstaly konkurenceschopné. I když je to stále raný trend, mohlo by to v příštím roce vést k nižším cenám API pro oblíbené modely, jako jsou DeepSeek a Qwen.

Hlavním přínosem je, že infrastrukturní řešení se vyvíjejí. Neo-cloudy se stávají atraktivnějšími nejen kvůli ceně a dostupnosti, ale také kvůli jejich potenciálu využít nevyužitou kapacitu a přenést tyto úspory na zákazníky.

InferenceSense nakonec představuje změnu paradigmatu ve využití GPU. Přeměnou prázdných cyklů na příjem přetváří FriendliAI ekonomiku vyvozování AI.