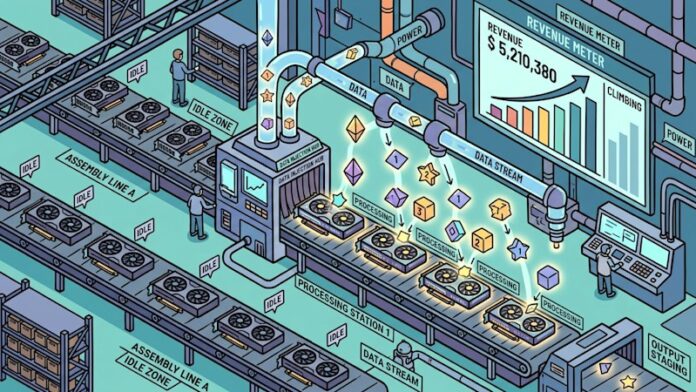

Die moderne KI-Landschaft ist von Zeiten verschwendeten Potenzials geprägt. GPU-Cluster, das Rückgrat des maschinellen Lernens, bleiben zwischen Trainingsläufen oder wechselnden Arbeitslasten oft im Leerlauf, dennoch entstehen den Betreibern weiterhin Kosten für Strom und Kühlung. FriendliAI, gegründet von dem Forscher hinter der weit verbreiteten kontinuierlichen Batch-Technik, bringt InferenceSense auf den Markt, eine Plattform, die diese zuvor verlorene Kapazität monetarisieren soll. Anstatt leistungsstarke Hardware im Dunkeln stehen zu lassen, ermöglicht InferenceSense Neocloud-Betreibern, Zugriff auf ungenutzte GPU-Zyklen für KI-Inferenzaufgaben zu verkaufen und die Einnahmen in Echtzeit aufzuteilen.

Das Kernproblem: Verschwendete Ressourcen

GPU-Cluster sind von Natur aus ineffizient. Schulungsaufträge werden beendet, die Nachfrage schwankt und teure Hardware bleibt inaktiv, während Fixkosten anfallen. Es gibt Spot-GPU-Märkte, aber sie erfordern, dass Cloud-Anbieter Kapazitäten vermieten, sodass der technische Aufwand und die Optimierung des Inferenzstapels dem Endbenutzer überlassen bleiben. Der Ansatz von FriendliAI ist grundlegend anders: Er ermöglicht es Betreibern, ungenutzte GPUs durch die Ausführung von Inferenz-Workloads direkt zu monetarisieren. Dadurch werden herkömmliche Mietmodelle umgangen und eine neue Einnahmequelle erschlossen.

Kontinuierliche Dosierung: Die Grundlage für Effizienz

Die Technologie hinter InferenceSense geht auf die Arbeit von Byung-Gon Chun zurück, einem Professor an der Seoul National University, dessen Forschung zum kontinuierlichen Batching die KI-Inferenz revolutionierte. In seinem Artikel „Orca“ aus dem Jahr 2020 stellte er eine dynamische Verarbeitungsmethode vor, die das Warten auf vollständige Stapel vor der Ausführung von Anforderungen vermeidet. Diese Technik, mittlerweile Industriestandard und in der beliebten vLLM-Inferenz-Engine implementiert, maximiert den Durchsatz.

Chuns Kerninnovation wird jetzt auf das Problem der GPU-Unterauslastung angewendet. Das Ziel besteht darin, Leerlaufzeiten mit bezahlten Inferenz-Workloads zu füllen, den Token-Durchsatz zu optimieren und die Einnahmen mit dem Betreiber zu teilen.

So funktioniert InferenceSense: Nahtlose Integration

InferenceSense lässt sich direkt in die bestehende Kubernetes-Infrastruktur integrieren, die die meisten Neocloud-Betreiber bereits für die Ressourcenorchestrierung nutzen. Betreiber weisen GPU-Pools einem von FriendliAI verwalteten Cluster zu und definieren Verfügbarkeits- und Rückforderungsbedingungen. Wenn GPUs nicht verwendet werden, startet die Plattform isolierte Container, um Inferenz-Workloads für Open-Weight-Modelle wie DeepSeek, Qwen und Kimi bereitzustellen.

Die Übergabe ist nahtlos konzipiert: Wenn der Planer des Betreibers Hardware zurück benötigt, werden Inferenz-Workloads innerhalb von Sekunden vorgezogen. FriendliAI übernimmt die Nachfrageaggregation über Direktkunden und Aggregatoren wie OpenRouter und sorgt so für einen konsistenten Auftragsfluss. Echtzeit-Dashboards bieten Betreibern Transparenz über die Modellnutzung, die Token-Verarbeitung und die erzielten Einnahmen.

Token-Durchsatz vs. Rohkapazität: Ein entscheidender Unterschied

Traditionelle Spot-GPU-Märkte monetarisieren die Rohkapazität. InferenceSense monetarisiert jedoch den Token-Durchsatz, was bedeutet, dass Betreiber auf der Grundlage der tatsächlichen KI-Verarbeitung verdienen, nicht nur auf der Grundlage ungenutzter Hardware. FriendliAI gibt an, dass seine Engine dank eines maßgeschneiderten C++-Stacks und proprietärer GPU-Kernel, die die cuDNN-Bibliothek von Nvidia umgehen, den zwei- bis dreimal höheren Durchsatz als Standard-vLLM-Bereitstellungen liefert.

Diese gesteigerte Effizienz führt direkt zu höheren Einnahmen pro ungenutztem Zyklus. Betreiber können mehr verdienen, indem sie Leerlaufzeiten mit Rückschlüssen füllen, als indem sie einfach Rohkapazitäten vermieten.

Implikationen für KI-Ingenieure und Kostenoptimierung

Für KI-Ingenieure könnte der Aufstieg von Plattformen wie InferenceSense die Ökonomie der Inferenz verändern. Da Neoclouds ungenutzte Kapazitäten monetarisieren, könnten sie dazu angeregt werden, die Token-Preise zu senken, um wettbewerbsfähig zu bleiben. Obwohl dieser Trend noch am Anfang steht, könnte er im Laufe des nächsten Jahres die API-Kosten für beliebte Modelle wie DeepSeek und Qwen senken.

Die wichtigste Erkenntnis ist, dass sich Infrastrukturentscheidungen weiterentwickeln. Neoclouds werden nicht nur wegen des Preises und der Verfügbarkeit immer attraktiver, sondern auch wegen ihres Potenzials, ungenutzte Kapazitäten zu nutzen und diese Einsparungen an die Kunden weiterzugeben.

Letztendlich stellt InferenceSense einen Paradigmenwechsel in der GPU-Nutzung dar. Indem FriendliAI verschwendete Zyklen in Einnahmen umwandelt, gestaltet es die Ökonomie der KI-Inferenz neu.