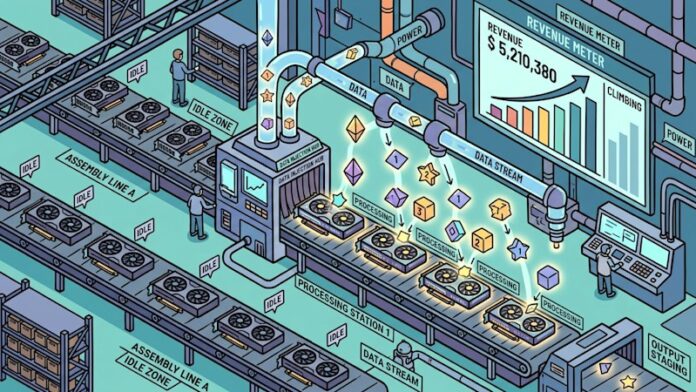

El panorama moderno de la IA está marcado por períodos de potencial desperdiciado. Los clústeres de GPU, la columna vertebral del aprendizaje automático, a menudo permanecen inactivos entre ejecuciones de entrenamiento o cambios de cargas de trabajo, pero los operadores continúan incurriendo en costos de energía y refrigeración. FriendliAI, fundada por el investigador detrás de la técnica de procesamiento por lotes continuo ampliamente adoptada, está lanzando InferenceSense, una plataforma diseñada para monetizar esta capacidad previamente perdida. En lugar de dejar que el hardware potente permanezca en la oscuridad, InferenceSense permite a los operadores de neocloud vender acceso a ciclos de GPU no utilizados para tareas de inferencia de IA, dividiendo los ingresos en tiempo real.

El problema central: recursos desperdiciados

Los clústeres de GPU son inherentemente ineficientes. Los trabajos de capacitación finalizan, la demanda fluctúa y el costoso hardware permanece inactivo mientras se acumulan los costos fijos. Existen mercados de GPU al contado, pero requieren que los proveedores de la nube alquilen capacidad, dejando la carga técnica y la optimización de la pila de inferencia al usuario final. El enfoque de FriendliAI es fundamentalmente diferente: permite a los operadores monetizar directamente las GPU inactivas mediante la ejecución de cargas de trabajo de inferencia. Esto evita los modelos de alquiler tradicionales y desbloquea una nueva fuente de ingresos.

Procesamiento por lotes continuo: la base de la eficiencia

La tecnología que impulsa InferenceSense surge del trabajo de Byung-Gon Chun, profesor de la Universidad Nacional de Seúl cuya investigación sobre procesamiento por lotes continuo revolucionó la inferencia de IA. Su artículo de 2020, Orca, introdujo un método de procesamiento dinámico que evita esperar lotes completos antes de ejecutar solicitudes. Esta técnica, ahora estándar de la industria e implementada en el popular motor de inferencia vLLM, maximiza el rendimiento.

La principal innovación de Chun se está aplicando ahora al problema de la subutilización de la GPU. El objetivo es llenar los ciclos inactivos con cargas de trabajo de inferencia pagas, optimizando el rendimiento de los tokens y compartiendo los ingresos con el operador.

Cómo funciona InferenceSense: integración perfecta

InferenceSense se integra directamente con la infraestructura de Kubernetes existente, que la mayoría de los operadores de neocloud ya utilizan para la orquestación de recursos. Los operadores asignan grupos de GPU a un clúster administrado por FriendliAI, definiendo condiciones de disponibilidad y recuperación. Cuando las GPU no se utilizan, la plataforma activa contenedores aislados para atender cargas de trabajo de inferencia para modelos abiertos como DeepSeek, Qwen y Kimi.

La transferencia está diseñada para ser fluida: cuando el programador del operador necesita hardware, las cargas de trabajo de inferencia se adelantan en cuestión de segundos. FriendliAI maneja la agregación de demanda a través de clientes directos y agregadores como OpenRouter, lo que garantiza un flujo constante de trabajos. Los paneles en tiempo real brindan a los operadores transparencia sobre el uso del modelo, el procesamiento de tokens y los ingresos obtenidos.

Rendimiento del token frente a capacidad bruta: una distinción crucial

Los mercados tradicionales de GPU al contado monetizan la capacidad bruta. InferenceSense, sin embargo, monetiza el rendimiento de los tokens, lo que significa que los operadores ganan en función del procesamiento real de la IA, no solo del hardware inactivo. FriendliAI afirma que su motor ofrece de dos a tres veces el rendimiento de las implementaciones vLLM estándar, gracias a una pila C++ personalizada y núcleos de GPU propietarios que omiten la biblioteca cuDNN de Nvidia.

Esta mayor eficiencia se traduce directamente en mayores ingresos por ciclo no utilizado. Los operadores pueden ganar más llenando el tiempo inactivo con inferencias que simplemente alquilando capacidad bruta.

Implicaciones para los ingenieros de IA y la optimización de costos

Para los ingenieros de IA, el auge de plataformas como InferenceSense podría cambiar la economía de la inferencia. A medida que las neonubes monetizan la capacidad inactiva, pueden verse incentivadas a bajar los precios de los tokens para seguir siendo competitivas. Aunque aún es temprana, esta tendencia podría reducir los costos de API para modelos populares como DeepSeek y Qwen durante el próximo año.

La conclusión clave es que las decisiones sobre infraestructura están evolucionando. Las neonubes se están volviendo más atractivas no solo por el precio y la disponibilidad, sino también por su potencial para aprovechar la capacidad no utilizada y trasladar esos ahorros a los clientes.

En última instancia, InferenceSense representa un cambio de paradigma en la utilización de GPU. Al convertir los ciclos desperdiciados en ingresos, FriendliAI está remodelando la economía de la inferencia de la IA.