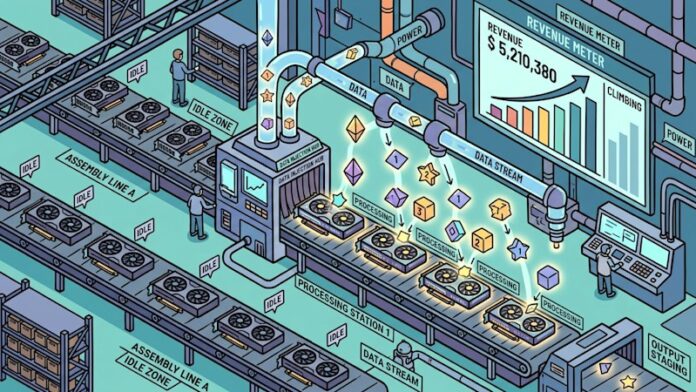

Lanskap AI modern ditandai dengan periode dimana potensi terbuang sia-sia. Cluster GPU, tulang punggung pembelajaran mesin, sering kali tidak digunakan saat pelatihan dijalankan atau perpindahan beban kerja, namun operator terus mengeluarkan biaya untuk daya dan pendinginan. FriendliAI, yang didirikan oleh peneliti di balik teknik batching berkelanjutan yang diadopsi secara luas, meluncurkan InferenceSense, sebuah platform yang dirancang untuk memonetisasi kapasitas yang sebelumnya hilang ini. Daripada membiarkan perangkat keras yang kuat diam saja, InferenceSense memungkinkan operator neocloud menjual akses ke siklus GPU yang tidak terpakai untuk tugas inferensi AI, sehingga membagi pendapatan secara real-time.

Masalah Inti: Sumber Daya yang Terbuang

Cluster GPU pada dasarnya tidak efisien. Pekerjaan pelatihan selesai, permintaan berfluktuasi, dan perangkat keras yang mahal tetap tidak aktif sementara biaya tetap menumpuk. Pasar GPU spot memang ada, namun mengharuskan vendor cloud untuk menyewakan kapasitas, sehingga beban teknis dan optimalisasi tumpukan inferensi diserahkan kepada pengguna akhir. Pendekatan FriendliAI pada dasarnya berbeda: pendekatan ini memungkinkan operator untuk secara langsung memonetisasi GPU yang menganggur dengan menjalankan beban kerja inferensi. Pendekatan ini mengabaikan model rental tradisional dan membuka aliran pendapatan baru.

Batching Berkelanjutan: Landasan Efisiensi

Teknologi yang mendorong InferenceSense berasal dari karya Byung-Gon Chun, seorang profesor di Universitas Nasional Seoul yang penelitiannya tentang pengelompokan berkelanjutan merevolusi inferensi AI. Makalahnya pada tahun 2020, Orca, memperkenalkan metode pemrosesan dinamis yang menghindari menunggu batch penuh sebelum mengeksekusi permintaan. Teknik ini, yang sekarang menjadi standar industri dan diterapkan di mesin inferensi vLLM yang populer, memaksimalkan throughput.

Inovasi inti Chun kini diterapkan pada masalah kurangnya pemanfaatan GPU. Tujuannya adalah untuk mengisi siklus menganggur dengan beban kerja inferensi berbayar, mengoptimalkan throughput token, dan berbagi pendapatan dengan operator.

Cara Kerja InferenceSense: Integrasi yang Mulus

InferenceSense terintegrasi langsung dengan infrastruktur Kubernetes yang sudah ada, yang sudah digunakan sebagian besar operator neocloud untuk orkestrasi sumber daya. Operator mengalokasikan kumpulan GPU ke kluster yang dikelola FriendliAI, menentukan kondisi ketersediaan dan klaim kembali. Saat GPU tidak digunakan, platform akan menjalankan container terisolasi untuk melayani beban kerja inferensi untuk model open-weight seperti DeepSeek, Qwen, dan Kimi.

Serah terima dirancang agar lancar: saat penjadwal operator memerlukan perangkat keras kembali, beban kerja inferensi akan didahulukan dalam hitungan detik. FriendliAI menangani agregasi permintaan melalui klien langsung dan agregator seperti OpenRouter, memastikan aliran pekerjaan yang konsisten. Dasbor real-time memberi operator transparansi mengenai penggunaan model, pemrosesan token, dan pendapatan yang diperoleh.

Throughput Token vs. Kapasitas Mentah: Perbedaan Penting

Pasar GPU spot tradisional memonetisasi kapasitas mentah. Namun, InferenceSense memonetisasi throughput token, yang berarti operator memperoleh penghasilan berdasarkan pemrosesan AI yang sebenarnya, bukan hanya perangkat keras yang menganggur. FriendliAI mengklaim mesinnya memberikan throughput dua hingga tiga kali lipat dari penerapan vLLM standar, berkat tumpukan C++ yang dibuat khusus dan kernel GPU berpemilik yang melewati pustaka cuDNN Nvidia.

Peningkatan efisiensi ini berarti pendapatan yang lebih tinggi per siklus yang tidak terpakai. Operator dapat memperoleh penghasilan lebih banyak dengan mengisi waktu menganggur dengan inferensi dibandingkan dengan hanya menyewakan kapasitas mentah.

Implikasi bagi Insinyur AI dan Pengoptimalan Biaya

Bagi para insinyur AI, munculnya platform seperti InferenceSense dapat mengubah aspek ekonomi inferensi. Ketika neocloud memonetisasi kapasitas yang menganggur, mereka mungkin diberi insentif untuk menurunkan harga token agar tetap kompetitif. Meskipun masih dalam tahap awal, tren ini dapat menurunkan biaya API untuk model populer seperti DeepSeek dan Qwen pada tahun depan.

Kesimpulan utamanya adalah keputusan mengenai infrastruktur terus berubah. Neoclouds menjadi lebih menarik tidak hanya karena harga dan ketersediaannya, namun juga karena potensinya dalam memanfaatkan kapasitas yang tidak terpakai dan meneruskan penghematan tersebut kepada pelanggan.

Pada akhirnya, InferenceSense mewakili perubahan paradigma dalam pemanfaatan GPU. Dengan mengubah siklus yang sia-sia menjadi pendapatan, FriendliAI membentuk kembali keekonomian inferensi AI.