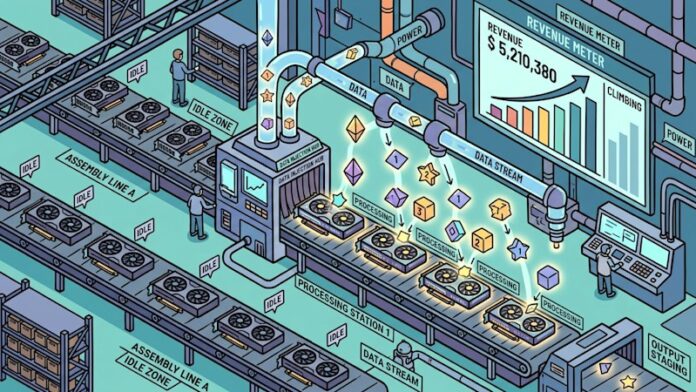

Il panorama moderno dell’intelligenza artificiale è caratterizzato da periodi di potenziale sprecato. I cluster GPU, la spina dorsale del machine learning, spesso restano inattivi tra le sessioni di formazione o lo spostamento dei carichi di lavoro, ma gli operatori continuano a sostenere costi per alimentazione e raffreddamento. FriendliAI, fondata dal ricercatore dietro la tecnica di batching continuo ampiamente adottata, sta lanciando InferenceSense, una piattaforma progettata per monetizzare questa capacità precedentemente persa. Invece di lasciare che l’hardware potente rimanga all’oscuro, InferenceSense consente agli operatori neocloud di vendere l’accesso a cicli GPU inutilizzati per attività di inferenza AI, dividendo le entrate in tempo reale.

Il problema principale: risorse sprecate

I cluster GPU sono intrinsecamente inefficienti. I lavori di formazione finiscono, la domanda fluttua e l’hardware costoso rimane inattivo mentre i costi fissi si accumulano. Esistono mercati spot delle GPU, ma richiedono ai fornitori di cloud di affittare la capacità, lasciando l’onere tecnico e l’ottimizzazione dello stack di inferenza all’utente finale. L’approccio di FriendlyAI è fondamentalmente diverso: consente agli operatori di monetizzare direttamente le GPU inattive eseguendo carichi di lavoro di inferenza. Ciò aggira i tradizionali modelli di noleggio e sblocca un nuovo flusso di entrate.

Batch continuo: il fondamento dell’efficienza

La tecnologia alla base di InferenceSense deriva dal lavoro di Byung-Gon Chun, professore alla Seoul National University, la cui ricerca sul batching continuo ha rivoluzionato l’inferenza dell’intelligenza artificiale. Il suo articolo del 2020, Orca, ha introdotto un metodo di elaborazione dinamica che evita di attendere batch completi prima di eseguire le richieste. Questa tecnica, ora standard del settore e implementata nel popolare motore di inferenza vLLM, massimizza il throughput.

L’innovazione principale di Chun viene ora applicata al problema del sottoutilizzo della GPU. L’obiettivo è riempire i cicli di inattività con carichi di lavoro di inferenza a pagamento, ottimizzando il throughput dei token e condividendo le entrate con l’operatore.

Come funziona InferenceSense: integrazione perfetta

InferenceSense si integra direttamente con l’infrastruttura Kubernetes esistente, che la maggior parte degli operatori neocloud già utilizza per l’orchestrazione delle risorse. Gli operatori assegnano pool GPU a un cluster gestito da FriendliAI, definendo le condizioni di disponibilità e recupero. Quando le GPU non vengono utilizzate, la piattaforma avvia contenitori isolati per servire carichi di lavoro di inferenza per modelli open-weight come DeepSeek, Qwen e Kimi.

Il trasferimento è progettato per essere fluido: quando lo scheduler dell’operatore necessita del supporto dell’hardware, i carichi di lavoro di inferenza vengono anticipati in pochi secondi. FriendliAI gestisce l’aggregazione della domanda attraverso clienti diretti e aggregatori come OpenRouter, garantendo un flusso coerente di lavori. I dashboard in tempo reale forniscono agli operatori trasparenza sull’utilizzo del modello, sull’elaborazione dei token e sui ricavi ottenuti.

Throughput dei token e capacità grezza: una distinzione cruciale

I tradizionali mercati spot delle GPU monetizzano la capacità grezza. InferenceSense, tuttavia, monetizza il throughput dei token, il che significa che gli operatori guadagnano in base all’effettiva elaborazione dell’intelligenza artificiale, non solo all’hardware inattivo. FriendliAI afferma che il suo motore offre da due a tre volte il throughput delle distribuzioni vLLM standard, grazie a uno stack C++ personalizzato e kernel GPU proprietari che bypassano la libreria cuDNN di Nvidia.

Questa maggiore efficienza si traduce direttamente in maggiori ricavi per ciclo inutilizzato. Gli operatori possono guadagnare di più riempiendo i tempi di inattività con l’inferenza piuttosto che semplicemente affittando capacità grezza.

Implicazioni per gli ingegneri dell’intelligenza artificiale e ottimizzazione dei costi

Per gli ingegneri dell’intelligenza artificiale, l’ascesa di piattaforme come InferenceSense potrebbe cambiare l’economia dell’inferenza. Poiché i neocloud monetizzano la capacità inattiva, potrebbero essere incentivati ad abbassare i prezzi dei token per rimanere competitivi. Anche se è ancora presto, questa tendenza potrebbe ridurre i costi delle API per modelli popolari come DeepSeek e Qwen nel corso del prossimo anno.

La conclusione fondamentale è che le decisioni relative alle infrastrutture si stanno evolvendo. I neocloud stanno diventando più attraenti non solo per il prezzo e la disponibilità, ma anche per il loro potenziale di sfruttare la capacità inutilizzata e trasferire tali risparmi ai clienti.

In definitiva, InferenceSense rappresenta un cambiamento di paradigma nell’utilizzo della GPU. Trasformando i cicli sprecati in entrate, FriendliAI sta rimodellando l’economia dell’inferenza dell’intelligenza artificiale.