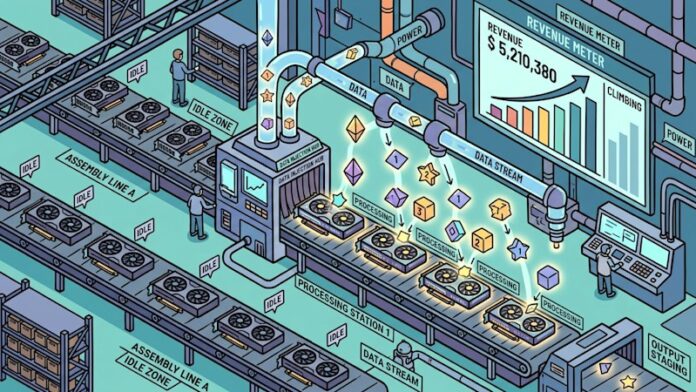

Obecny krajobraz sztucznej inteligencji charakteryzuje się okresami utraconego potencjału. Klastry GPU, będące podstawą uczenia maszynowego, często pozostają bezczynne pomiędzy iteracjami szkoleniowymi lub gdy zmienia się obciążenie, ale operatorzy w dalszym ciągu ponoszą koszty zasilania i chłodzenia. FriendliAI, założona przez badacza szeroko stosowanej techniki ciągłego przetwarzania wsadowego, uruchamia InferenceSense, platformę zaprojektowaną w celu monetyzacji wcześniej zmarnowanej pojemności. Zamiast pozwalać potężnemu sprzętowi pozostać bezczynnym, InferenceSense pozwala operatorom neo-cloud sprzedawać dostęp do niewykorzystanych cykli GPU na potrzeby zadań wnioskowania AI, dzieląc się przychodami w czasie rzeczywistym.

Główny problem: Nieefektywne wykorzystanie zasobów

Klastry GPU są z natury nieefektywne. Zadania szkoleniowe są zakończone, popyt się zmienia, a kosztowny sprzęt pozostaje bezczynny, podczas gdy kumulują się koszty stałe. Istnieją rynki spotowych procesorów graficznych, ale wymagają one od dostawców usług w chmurze dzierżawienia pojemności, pozostawiając obciążenie techniczne i optymalizację stosu wnioskowania użytkownikowi końcowemu. Podejście FriendliAI jest zasadniczo odmienne: umożliwia operatorom bezpośrednie zarabianie na bezczynnych procesorach graficznych poprzez uruchamianie obciążeń wnioskowania. Omija to tradycyjne modele wynajmu i otwiera nowe źródło przychodów.

Ciągłe przetwarzanie wsadowe: podstawa wydajności

Technologia stojąca za InferenceSense jest wynikiem pracy Byung-Gon Chuna, profesora na Uniwersytecie Narodowym w Seulu, którego badania nad ciągłym procesem wsadowym zrewolucjonizowały wnioskowanie AI. W swojej pracy z 2020 r., Orca, przedstawił metodę dynamicznego przetwarzania, która pozwala uniknąć czekania na pełne pakiety przed wykonaniem żądań. Technika ta, będąca obecnie standardem branżowym i zaimplementowana w popularnym silniku wnioskowania vLLM, maksymalizuje przepustowość.

Podstawowa innowacja Chun jest obecnie stosowana w celu rozwiązania problemu niedostatecznego wykorzystania procesorów graficznych. Celem jest wypełnienie cykli bezczynności płatnymi obciążeniami wnioskowania, optymalizacja przepustowości tokena i dzielenie się przychodami z operatorem.

Jak działa InferenceSense: bezproblemowa integracja

InferenceSense integruje się bezpośrednio z istniejącą infrastrukturą Kubernetes, której większość operatorów neo-cloud używa już do orkiestracji zasobów. Operatorzy przydzielają pule GPU do klastra zarządzanego przez FriendliAI, określając warunki dostępności i anulowania. Gdy procesory graficzne nie są używane, platforma uruchamia izolowane kontenery, aby obsługiwać obciążenia wnioskowania dla modeli o otwartej wadze, takich jak DeepSeek, Qwen i Kimi.

Proces zaprojektowano tak, aby przebiegał bezproblemowo: gdy osoba planująca operator potrzebuje sprzętu, obciążenia wnioskowania są przerywane w ciągu kilku sekund. FriendliAI obsługuje agregację popytu za pośrednictwem bezpośrednich klientów i agregatorów, takich jak OpenRouter, zapewniając stały strumień zadań. Pulpity nawigacyjne działające w czasie rzeczywistym zapewniają operatorom przejrzystość w zakresie wykorzystania modelu, przetwarzania tokenów i generowanych przychodów.

Przepustowość tokena a surowa moc: kluczowa różnica

Tradycyjne rynki spotowych procesorów graficznych monetyzują surową moc. InferenceSense monetyzuje jednak przepustowość tokenów, co oznacza, że operatorzy zarabiają na rzeczywistym przetwarzaniu sztucznej inteligencji, a nie tylko na bezczynnym sprzęcie. FriendliAI twierdzi, że jego silnik zapewnia od dwóch do trzech razy większą przepustowość w porównaniu ze standardowymi wdrożeniami vLLM, dzięki niestandardowemu stosowi C++ i zastrzeżonym rdzeniom GPU, które omijają bibliotekę cuDNN firmy Nvidia.

Ta zwiększona wydajność bezpośrednio przekłada się na wyższy przychód na niewykorzystany cykl. Operatorzy mogą zarobić więcej, wypełniając czas przestoju infertem, niż po prostu wynajmując surową pojemność.

Konsekwencje dla inżynierów zajmujących się sztuczną inteligencją i optymalizacją kosztów

Dla inżynierów AI pojawienie się platform takich jak InferenceSense może zmienić ekonomikę wnioskowania. Ponieważ neo-chmury zarabiają na niewykorzystanej pojemności, mogą mieć motywację do obniżania cen tokenów, aby zachować konkurencyjność. Chociaż jest to wciąż wczesny trend, może w przyszłym roku doprowadzić do obniżenia cen API dla popularnych modeli, takich jak DeepSeek i Qwen.

Główny wniosek jest taki, że rozwiązania infrastrukturalne ewoluują. Neochmury stają się coraz bardziej atrakcyjne nie tylko ze względu na cenę i dostępność, ale także ze względu na ich potencjał wykorzystania niewykorzystanej pojemności i przekazania oszczędności klientom.

Ostatecznie InferenceSense reprezentuje zmianę paradygmatu w wykorzystaniu procesora graficznego. Zamieniając puste cykle w dochód, FriendliAI zmienia ekonomię wnioskowania AI.