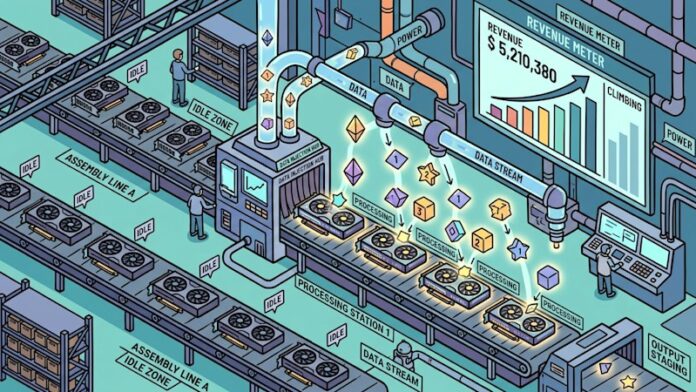

O cenário moderno da IA é marcado por períodos de potencial desperdiçado. Os clusters de GPU, a espinha dorsal do aprendizado de máquina, muitas vezes ficam ociosos entre execuções de treinamento ou mudanças de cargas de trabalho, mas as operadoras continuam a incorrer em custos de energia e resfriamento. FriendliAI, fundada pelo pesquisador por trás da técnica de lote contínuo amplamente adotada, está lançando o InferenceSense, uma plataforma projetada para monetizar essa capacidade anteriormente perdida. Em vez de deixar hardware poderoso parado, o InferenceSense permite que operadores de neocloud vendam acesso a ciclos de GPU não utilizados para tarefas de inferência de IA, dividindo a receita em tempo real.

O problema central: recursos desperdiçados

Clusters de GPU são inerentemente ineficientes. Os trabalhos de treinamento terminam, a demanda flutua e o hardware caro permanece inativo enquanto os custos fixos se acumulam. Existem mercados spot de GPU, mas exigem que os fornecedores de nuvem aluguem capacidade, deixando a carga técnica e a otimização da pilha de inferência para o usuário final. A abordagem da FriendliAI é fundamentalmente diferente: ela permite que as operadoras monetizem diretamente GPUs ociosas executando cargas de trabalho de inferência. Isso contorna os modelos tradicionais de aluguel e abre um novo fluxo de receita.

Lotes Contínuos: A Base da Eficiência

A tecnologia que impulsiona o InferenceSense deriva do trabalho de Byung-Gon Chun, professor da Universidade Nacional de Seul, cuja pesquisa sobre lote contínuo revolucionou a inferência de IA. Seu artigo de 2020, Orca, introduziu um método de processamento dinâmico que evita esperar por lotes completos antes de executar solicitações. Essa técnica, agora padrão do setor e implementada no popular mecanismo de inferência vLLM, maximiza o rendimento.

A principal inovação de Chun agora está sendo aplicada ao problema de subutilização da GPU. O objetivo é preencher os ciclos ociosos com cargas de trabalho de inferência pagas, otimizando o rendimento do token e compartilhando a receita com a operadora.

Como funciona o InferenceSense: integração perfeita

O InferenceSense integra-se diretamente à infraestrutura existente do Kubernetes, que a maioria dos operadores de neocloud já usa para orquestração de recursos. Os operadores alocam pools de GPU para um cluster gerenciado pelo FriendliAI, definindo condições de disponibilidade e recuperação. Quando as GPUs não são utilizadas, a plataforma ativa contêineres isolados para atender cargas de trabalho de inferência para modelos abertos como DeepSeek, Qwen e Kimi.

A transferência foi projetada para ser perfeita: quando o agendador do operador precisa de hardware de volta, as cargas de trabalho de inferência são interrompidas em segundos. FriendliAI lida com a agregação de demanda por meio de clientes diretos e agregadores como OpenRouter, garantindo um fluxo consistente de trabalhos. Painéis em tempo real fornecem aos operadores transparência sobre o uso do modelo, processamento de tokens e receita obtida.

Taxa de transferência de token versus capacidade bruta: uma distinção crucial

Os mercados spot tradicionais de GPU monetizam a capacidade bruta. O InferenceSense, no entanto, monetiza o rendimento do token, o que significa que as operadoras ganham com base no processamento real da IA, e não apenas no hardware ocioso. FriendliAI afirma que seu mecanismo oferece duas a três vezes o rendimento de implantações vLLM padrão, graças a uma pilha C++ personalizada e kernels de GPU proprietários que ignoram a biblioteca cuDNN da Nvidia.

Este aumento de eficiência se traduz diretamente em maiores receitas por ciclo não utilizado. Os operadores podem ganhar mais preenchendo o tempo ocioso com inferências do que simplesmente alugando capacidade bruta.

Implicações para engenheiros de IA e otimização de custos

Para os engenheiros de IA, o surgimento de plataformas como o InferenceSense poderia mudar a economia da inferência. À medida que as neonuvens monetizam a capacidade ociosa, elas podem ser incentivadas a reduzir os preços dos tokens para permanecerem competitivas. Embora ainda seja cedo, essa tendência poderá reduzir os custos de API para modelos populares como DeepSeek e Qwen no próximo ano.

A principal conclusão é que as decisões de infraestrutura estão evoluindo. As neoclouds estão se tornando mais atraentes não apenas pelo preço e pela disponibilidade, mas também pelo seu potencial de aproveitar a capacidade não utilizada e repassar essas economias aos clientes.

Em última análise, o InferenceSense representa uma mudança de paradigma na utilização da GPU. Ao transformar ciclos desperdiçados em receitas, a FriendliAI está remodelando a economia da inferência de IA.