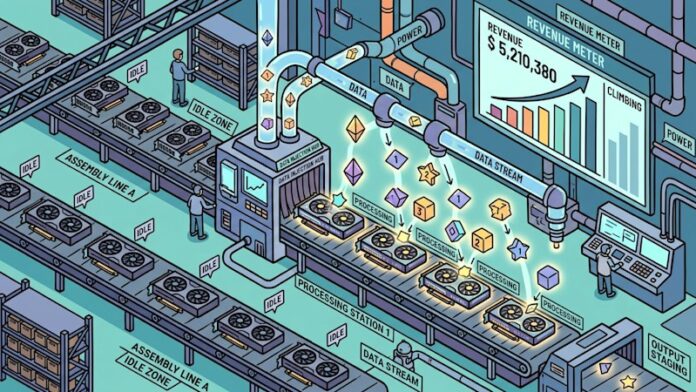

Современный ландшафт ИИ характеризуется периодами упущенного потенциала. GPU-кластеры, основа машинного обучения, часто простаивают между обучающими итерациями или при изменении рабочей нагрузки, однако операторы продолжают нести затраты на электроэнергию и охлаждение. FriendliAI, основанная исследователем, стоящим за широко распространенной техникой непрерывного пакетирования, запускает InferenceSense – платформу, разработанную для монетизации ранее потерянных мощностей. Вместо того чтобы позволять мощному оборудованию оставаться неактивным, InferenceSense позволяет операторам неоклаудов продавать доступ к неиспользуемым GPU-циклам для задач ИИ-инференса, разделяя доход в режиме реального времени.

Основная Проблема: Неэффективное Использование Ресурсов

GPU-кластеры по своей природе неэффективны. Обучающие задачи завершаются, спрос колеблется, а дорогостоящее оборудование остается неактивным, в то время как фиксированные затраты накапливаются. Существуют спотовые GPU-рынки, но они требуют от облачных провайдеров сдачи в аренду мощностей, оставляя техническое бремя и оптимизацию стека инференса на конечного пользователя. Подход FriendliAI принципиально отличается: он позволяет операторам напрямую монетизировать простаивающие GPU, запуская рабочие нагрузки инференса. Это обходит традиционные модели аренды и открывает новый источник дохода.

Непрерывное Пакетное Обработка: Основа Эффективности

Технология, лежащая в основе InferenceSense, является результатом работы Бён-Гон Чуна, профессора Сеульского национального университета, чьи исследования в области непрерывного пакетного процесса произвели революцию в ИИ-инференсе. Его статья 2020 года, Orca, представила динамический метод обработки, который избегает ожидания полных пакетов перед выполнением запросов. Эта техника, которая сейчас является отраслевым стандартом и реализована в популярном движке инференса vLLM, максимизирует пропускную способность.

Основная инновация Чуна теперь применяется для решения проблемы неполной утилизации GPU. Цель состоит в том, чтобы заполнить неактивные циклы платными рабочими нагрузками инференса, оптимизируя пропускную способность токенов и делясь доходом с оператором.

Как Работает InferenceSense: Бесшовная Интеграция

InferenceSense напрямую интегрируется с существующей инфраструктурой Kubernetes, которую большинство операторов неоклаудов уже используют для оркестрации ресурсов. Операторы выделяют GPU-пулы в кластер, управляемый FriendliAI, определяя доступность и условия отмены. Когда GPU не используются, платформа запускает изолированные контейнеры для обслуживания рабочих нагрузок инференса для моделей с открытым весом, таких как DeepSeek, Qwen и Kimi.

Процесс разработан таким образом, чтобы быть бесшовным: когда планировщик оператора нуждается в аппаратном обеспечении, рабочие нагрузки инференса прерываются в течение нескольких секунд. FriendliAI обрабатывает агрегирование спроса через прямых клиентов и агрегаторов, таких как OpenRouter, обеспечивая постоянный поток задач. Панели управления в реальном времени предоставляют операторам прозрачность в отношении использования моделей, обработки токенов и полученного дохода.

Пропускная Способность Токенов vs. Сырая Мощность: Ключевое Различие

Традиционные спотовые GPU-рынки монетизируют сырую мощность. InferenceSense, однако, монетизирует пропускную способность токенов, то есть операторы зарабатывают на основе фактической обработки ИИ, а не просто на неактивном оборудовании. FriendliAI утверждает, что ее движок обеспечивает пропускную способность в два-три раза выше, чем стандартные развертывания vLLM, благодаря специально разработанному стеку на C++ и проприетарным GPU-ядрам, которые обходят библиотеку Nvidia cuDNN.

Эта повышенная эффективность напрямую переводится в более высокий доход за неиспользованный цикл. Операторы могут зарабатывать больше, заполняя неактивное время инфересом, чем просто сдавая в аренду сырую мощность.

Последствия для Инженеров ИИ и Оптимизации Затрат

Для инженеров ИИ появление платформ, таких как InferenceSense, может изменить экономику инференса. Поскольку неоклауды монетизируют неиспользуемые мощности, у них может появиться стимул снижать цены на токены, чтобы оставаться конкурентоспособными. Хотя пока это ранняя тенденция, она может привести к снижению цен на API для популярных моделей, таких как DeepSeek и Qwen, в течение следующего года.

Главный вывод заключается в том, что инфраструктурные решения эволюционируют. Неоклауды становятся более привлекательными не только из-за цены и доступности, но и из-за их потенциала использовать неиспользуемые мощности и передавать эту экономию клиентам.

В конечном итоге, InferenceSense представляет собой смену парадигмы в использовании GPU. Превращая пустые циклы в доход, FriendliAI перестраивает экономику ИИ-инференса.