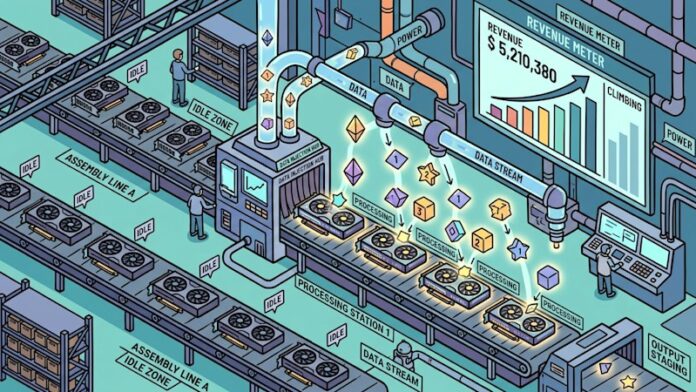

Le paysage moderne de l’IA est marqué par des périodes de gaspillage de potentiel. Les clusters GPU, l’épine dorsale de l’apprentissage automatique, restent souvent inutilisés entre les cycles de formation ou les changements de charges de travail, mais les opérateurs continuent de supporter des coûts d’alimentation et de refroidissement. FriendliAI, fondée par le chercheur à l’origine de la technique de traitement par lots continu largement adoptée, lance InferenceSense, une plate-forme conçue pour monétiser cette capacité précédemment perdue. Au lieu de laisser du matériel puissant dans l’obscurité, InferenceSense permet aux opérateurs néocloud de vendre l’accès aux cycles GPU inutilisés pour les tâches d’inférence d’IA, partageant ainsi les revenus en temps réel.

Le problème central : le gaspillage des ressources

Les clusters GPU sont intrinsèquement inefficaces. Les tâches de formation se terminent, la demande fluctue et le matériel coûteux reste inactif tandis que les coûts fixes s’accumulent. Des marchés de GPU ponctuels existent, mais ils obligent les fournisseurs de cloud à louer de la capacité, laissant la charge technique et l’optimisation de la pile d’inférence à l’utilisateur final. L’approche de FriendliAI est fondamentalement différente : elle permet aux opérateurs de monétiser directement les GPU inactifs en exécutant des charges de travail d’inférence. Cela contourne les modèles de location traditionnels et débloque une nouvelle source de revenus.

Traitement par lots continu : le fondement de l’efficacité

La technologie à la base d’InferenceSense découle des travaux de Byung-Gon Chun, professeur à l’Université nationale de Séoul dont les recherches sur le traitement par lots continu ont révolutionné l’inférence de l’IA. Son article de 2020, Orca, a introduit une méthode de traitement dynamique qui évite d’attendre des lots complets avant d’exécuter des requêtes. Cette technique, désormais standard dans l’industrie et implémentée dans le populaire moteur d’inférence vLLM, maximise le débit.

L’innovation principale de Chun est désormais appliquée au problème de la sous-utilisation du GPU. L’objectif est de remplir les cycles d’inactivité avec des charges de travail d’inférence payantes, en optimisant le débit des jetons et en partageant les revenus avec l’opérateur.

Comment fonctionne InferenceSense : intégration transparente

InferenceSense s’intègre directement à l’infrastructure Kubernetes existante, que la plupart des opérateurs néocloud utilisent déjà pour l’orchestration des ressources. Les opérateurs allouent des pools GPU à un cluster géré par FriendliAI, définissant les conditions de disponibilité et de récupération. Lorsque les GPU ne sont pas utilisés, la plate-forme fait tourner des conteneurs isolés pour servir les charges de travail d’inférence pour les modèles ouverts comme DeepSeek, Qwen et Kimi.

Le transfert est conçu pour être transparent : lorsque le planificateur de l’opérateur a besoin de récupérer du matériel, les charges de travail d’inférence sont préemptées en quelques secondes. FriendliAI gère l’agrégation de la demande via des clients directs et des agrégateurs comme OpenRouter, garantissant ainsi un flux cohérent de tâches. Les tableaux de bord en temps réel offrent aux opérateurs une transparence sur l’utilisation du modèle, le traitement des jetons et les revenus gagnés.

Débit des jetons par rapport à la capacité brute : une distinction cruciale

Les marchés spot traditionnels des GPU monétisent la capacité brute. InferenceSense, cependant, monétise le débit des jetons, ce qui signifie que les opérateurs gagnent en fonction du traitement réel de l’IA, et pas seulement du matériel inactif. FriendliAI affirme que son moteur offre un débit deux à trois fois supérieur aux déploiements vLLM standard, grâce à une pile C++ personnalisée et à des noyaux GPU propriétaires qui contournent la bibliothèque cuDNN de Nvidia.

Cette efficacité accrue se traduit directement par des revenus plus élevés par cycle inutilisé. Les opérateurs peuvent gagner davantage en comblant les périodes d’inactivité avec l’inférence plutôt qu’en louant simplement de la capacité brute.

Implications pour les ingénieurs en IA et l’optimisation des coûts

Pour les ingénieurs en IA, la montée en puissance de plateformes comme InferenceSense pourrait modifier l’économie de l’inférence. À mesure que les néoclouds monétisent la capacité inutilisée, ils peuvent être incités à baisser les prix des jetons pour rester compétitifs. Bien qu’elle soit encore précoce, cette tendance pourrait réduire les coûts des API pour les modèles populaires comme DeepSeek et Qwen au cours de l’année prochaine.

Ce qu’il faut retenir, c’est que les décisions en matière d’infrastructure évoluent. Les Neoclouds deviennent de plus en plus attractifs non seulement pour leur prix et leur disponibilité, mais également pour leur capacité à exploiter la capacité inutilisée et à répercuter ces économies sur les clients.

En fin de compte, InferenceSense représente un changement de paradigme dans l’utilisation du GPU. En transformant les cycles gaspillés en revenus, FriendliAI remodèle l’économie de l’inférence de l’IA.