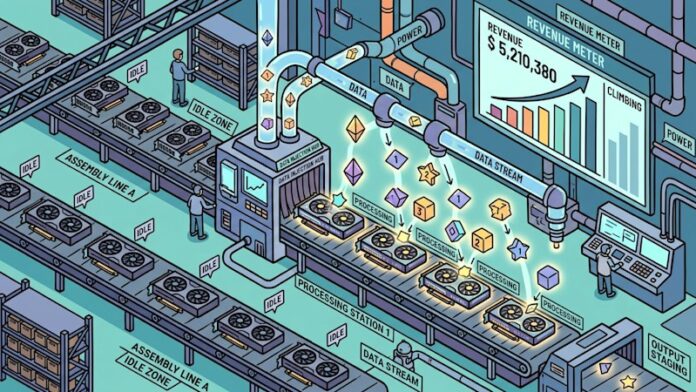

Het moderne AI-landschap wordt gekenmerkt door perioden van verspild potentieel. GPU-clusters, de ruggengraat van machine learning, staan vaak stil tussen trainingssessies of wisselende werklasten, maar operators blijven kosten maken voor stroom en koeling. FriendliAI, opgericht door de onderzoeker achter de algemeen aanvaarde continue batchingtechniek, lanceert InferenceSense, een platform dat is ontworpen om geld te verdienen met deze voorheen verloren capaciteit. In plaats van krachtige hardware in het ongewisse te laten, stelt InferenceSense neocloud-operators in staat toegang te verkopen tot ongebruikte GPU-cycli voor AI-inferentietaken, waardoor de inkomsten in realtime worden verdeeld.

### Het kernprobleem: verspilde hulpbronnen

GPU-clusters zijn inherent inefficiënt. Trainingstaken eindigen, de vraag fluctueert en dure hardware blijft inactief terwijl de vaste kosten zich opstapelen. Er bestaan spot-GPU-markten, maar deze vereisen dat cloudleveranciers capaciteit verhuren, waardoor de technische lasten en de optimalisatie van de gevolgtrekking aan de eindgebruiker worden overgelaten. De aanpak van FriendliAI is fundamenteel anders: het stelt operators in staat om direct inkomsten te genereren met inactieve GPU’s door inferentieworkloads uit te voeren. Dit omzeilt traditionele verhuurmodellen en ontsluit een nieuwe inkomstenstroom.

Continu batchen: de basis voor efficiëntie

De technologie die InferenceSense aandrijft, komt voort uit het werk van Byung-Gon Chun, een professor aan de Seoul National University wiens onderzoek naar continue batching een revolutie teweegbracht in AI-inferentie. Zijn paper uit 2020, Orca, introduceerde een dynamische verwerkingsmethode die voorkomt dat er op volledige batches moet worden gewacht voordat verzoeken worden uitgevoerd. Deze techniek, nu industriestandaard en geïmplementeerd in de populaire vLLM-inferentie-engine, maximaliseert de doorvoer.

Chun’s kerninnovatie wordt nu toegepast op het probleem van GPU-onderbenutting. Het doel is om inactieve cycli te vullen met betaalde inferentieworkloads, het optimaliseren van tokendoorvoer en het delen van inkomsten met de operator.

Hoe InferenceSense werkt: naadloze integratie

InferenceSense integreert rechtstreeks met de bestaande Kubernetes-infrastructuur, die de meeste neocloud-operators al gebruiken voor resource-orkestratie. Operators wijzen GPU-pools toe aan een door FriendliAI beheerd cluster, waarbij de beschikbaarheid en terugvorderingsvoorwaarden worden gedefinieerd. Wanneer GPU’s niet worden gebruikt, draait het platform geïsoleerde containers op om gevolgtrekkingswerklasten te leveren voor open-weight-modellen zoals DeepSeek, Qwen en Kimi.

De overdracht is ontworpen om naadloos te verlopen: wanneer de planner van de operator hardware terug nodig heeft, worden de gevolgtrekkingswerklasten binnen enkele seconden ondervangen. FriendliAI verwerkt de vraagaggregatie via directe klanten en aggregators zoals OpenRouter, waardoor een consistente stroom van banen wordt gegarandeerd. Realtime dashboards bieden operators transparantie over modelgebruik, tokenverwerking en verdiende inkomsten.

Tokendoorvoer versus ruwe capaciteit: een cruciaal onderscheid

Traditionele spot-GPU-markten genereren brute capaciteit. InferenceSense genereert echter inkomsten uit de tokendoorvoer, wat betekent dat operators verdienen op basis van daadwerkelijke AI-verwerking, en niet alleen op inactieve hardware. FriendliAI beweert dat zijn engine twee tot drie keer de doorvoer levert van standaard vLLM-implementaties, dankzij een op maat gemaakte C++-stack en eigen GPU-kernels die de cuDNN-bibliotheek van Nvidia omzeilen.

Deze verhoogde efficiëntie vertaalt zich direct in een hogere omzet per ongebruikte cyclus. Exploitanten kunnen meer verdienen door inactieve tijd op te vullen met gevolgtrekkingen dan door eenvoudigweg ruwe capaciteit te verhuren.

Implicaties voor AI-ingenieurs en kostenoptimalisatie

Voor AI-ingenieurs zou de opkomst van platforms als InferenceSense de economie van inferentie kunnen veranderen. Terwijl neoclouds geld verdienen met onbenutte capaciteit, kunnen ze gestimuleerd worden om de symbolische prijzen te verlagen om concurrerend te blijven. Hoewel deze trend nog vroeg is, zou deze de API-kosten voor populaire modellen als DeepSeek en Qwen het komende jaar kunnen verlagen.

De belangrijkste conclusie is dat infrastructuurbeslissingen evolueren. Neoclouds worden niet alleen aantrekkelijker vanwege de prijs en beschikbaarheid, maar ook vanwege hun potentieel om ongebruikte capaciteit te benutten en deze besparingen door te geven aan klanten.

Uiteindelijk vertegenwoordigt InferenceSense een paradigmaverschuiving in het GPU-gebruik. Door verspilde cycli om te zetten in inkomsten, hervormt FriendliAI de economie van AI-inferentie.