Ландшафт открытого ИИ претерпел стремительные изменения с момента выхода ChatGPT в 2022 году, где лидерство перешло от серии Llama от Meta к китайским лабораториям, таким как Qwen и z.ai. Однако, недавняя тенденция к проприетарным моделям со стороны китайских компаний и перепрофилирование их технологий американскими фирмами создали нишу для нового лидера. San Francisco-based Arcee AI выступила вперед, выпустив Trinity-Large-Thinking — текстовую модель с 399 миллиардами параметров, предназначенную исключительно для логических задач, под полностью разрешительной лицензией Apache 2.0. Это предоставляет предприятиям и разработчикам полную кастомизацию и коммерческие права использования, что является стратегической ставкой на американские открытые веса как суверенную альтернативу все более ограниченным передовым моделям ИИ.

Подъем Американского Открытого ИИ

Релиз Arcee — это не просто очередной набор весов на Hugging Face; это прямой ответ на растущую обеспокоенность предприятий, полагающихся на китайские архитектуры для критической инфраструктуры. Спрос на отечественную альтернативу очевиден, как отметил Клеман Деланг, соучредитель и генеральный директор Hugging Face: “Сила США всегда заключалась в её стартапах, так что, возможно, именно на них стоит рассчитывать в лидерстве в открытом ИИ. Arcee показывает, что это возможно!” Этот сдвиг сигнализирует о стратегическом перевыравнивании, поскольку глобальные лаборатории переходят к проприетарному замкнутому циклу, оставляя место для независимых американских инноваций.

Как Arcee Создала Передовую Модель с Ограниченными Ресурсами

Arcee работает с небольшой командой всего из 30 человек, резко контрастируя с тысячами инженеров и многомиллиардными бюджетами конкурентов, таких как OpenAI и Google. Главный технический директор Лукас Аткинс определяет их подход как “инженерия через ограничения.” Компания привлекла 24 миллиона долларов в серии A финансирования в 2024 году, доведя общий капитал почти до 50 миллионов долларов. Затем они направили почти половину этих средств — 20 миллионов долларов — на одно 33-дневное обучение Trinity Large.

Используя 2048 графических процессоров NVIDIA B300 Blackwell (вдвое быстрее, чем предыдущее поколение), Arcee доказала, что сфокусированная команда может создать полный конвейер и стабилизировать обучение без неограниченных резервов. Эта капитальная эффективность является определяющей характеристикой проекта.

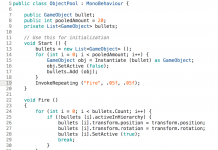

Технические Инновации: Разреженное Внимание и Синтетические Данные

Trinity-Large-Thinking выделяется благодаря своему высокоразреженному механизму внимания. Имея 400 миллиардов параметров, только 1,56% (13 миллиардов) активны на токен, что обеспечивает баланс между глубокими знаниями и быстрой скоростью вывода. Эта архитектура представляла собой проблемы стабильности, которые Arcee решила с помощью SMEBU (Soft-clamped Momentum Expert Bias Updates), обеспечивая равномерную экспертную специализацию в общем корпусе.

Модель также использует гибридный подход скользящего окна (соотношение 3:1 локального к глобальному вниманию) для производительности в длинном контексте. Чтобы обеспечить качество данных, Arcee сотрудничала с DatologyAI для курирования более 10 триллионов токенов и расширения до 20 триллионов, балансируя веб-данные с высококачественными синтетическими данными, сгенерированными путем переписывания необработанного текста (Wikipedia, блоги), чтобы сжать информацию. Это позволяет избежать проблем запоминания, характерных для имитационных синтетических данных, улучшая рассуждения.

От Чат-ботов к Рассуждающим Агентам: Обновление “Thinking”

Официальный релиз знаменует переход от стандартной “инструктивной” модели к “рассуждающей” модели, отвечая на критику ранних пользователей Preview-релиза. Trinity-Large-Thinking теперь реализует фазу “мышления” перед ответом, подобно внутренним циклам в Trinity-Mini. Это решает проблему многоступенчатых инструкций в сложных средах, позволяя агентам с долгосрочным горизонтом, способным поддерживать согласованность при выполнении нескольких вызовов инструментов без ошибок.

Этот процесс рассуждения улучшает согласованность контекста и следование инструкциям, что делает его полезным в отраслях, ориентированных на аудит, где прозрачные трассы “мышление-ответ” критически важны. Цель состоит в том, чтобы выйти за рамки ненадежных чат-ботов к стабильным, дешевым, высококачественным агентам.

Геополитика и Будущее Открытых Весов

Лицензия Apache 2.0 — это преднамеренный выбор на рынке, где конкуренты переходят к проприетарным моделям. В отличие от ограничительных лицензий, Apache 2.0 позволяет полностью владеть, проверять и кастомизировать. Лукас Аткинс отмечает: “Разработчикам и предприятиям нужны модели, которые они могут проверять, обучать, размещать, дистиллировать и владеть.” Это владение критически важно для обучения небольших моделей, поскольку большие передовые модели часто необходимы для генерации высококачественных синтетических данных.

Релиз Arcee Trinity-Large-TrueBase — необработанного контрольного пункта на 10 триллионов токенов — предлагает редкий взгляд на фундаментальный интеллект до настройки, позволяя проводить аутентичные аудиты в регулируемых отраслях, таких как финансы и оборона.

Бенчмарки и Производительность

Trinity-Large-Thinking является законным конкурентом передового уровня. На PinchBench она набрала 91,9, что близко к Claude Opus 4.6 (93,3). На IFBench она соответствовала Opus 4.6 с результатом 52,3, доказывая, что обновление “Thinking” исправило проблемы следования инструкциям. AIME25 показал результат 96,3, соответствуя Kimi-K2.5 и превосходя GLM-5 (93,3) и MiniMax-M2.7 (80,0).

В то время как кодирующие бенчмарки, такие как SWE-bench Verified, по-прежнему отдают предпочтение закрытым моделям, стоимость Trinity за токен (0,90 доллара за миллион) на 96% дешевле, чем Opus 4.6 (25 долларов за миллион). Другие американские модели с открытым исходным кодом включают gpt-oss-120B от OpenAI, Gemma 4 от Google и семейство Granite от IBM, но модель Arcee превосходит их по экономической эффективности и адаптивности.

Выбор Правильной Модели

- Arcee Trinity-Large-Thinking: Идеально подходит для автономных агентов, нуждающихся в планировании на уровне GPT-4o по более низкой цене.

- gpt-oss-120B: Лучший компромисс для высококачественного рассуждения с более низкими операционными затратами.

- Google Gemma 4: Универсальный для НИОКР и высокоскоростных чат-интерфейсов.

- IBM Granite 4.0: Надежный для крупномасштабной обработки документов в регулируемых отраслях.

Суверенный Инфраструктурный Слой

Поскольку лаборатории переходят к проприетарным моделям, Arcee позиционирует Trinity как суверенный инфраструктурный слой. Стратегия компании теперь сосредоточена на дистилляции передового уровня рассуждений в свои модели Mini и Nano, обеспечивая продолжение инноваций в открытом исходном коде.

Релиз Trinity-Large-Thinking представляет собой важный шаг к независимой американской разработке ИИ.