Питання про те, чи буде людство контролювати штучний інтелект або ІІ в кінцевому підсумку візьме гору, перестав бути футуристичною фантазією. Це нагальна проблема з огляду на стрімке поширення потужних інструментів ІІ, таких як ChatGPT, Gemini та Copilot. Ця реальність моторошно перегукується з темами, дослідженими у фільмі Стенлі Кубріка 1968 року 2001 рік: Космічна одіссея, де ІІ-комп’ютер HAL бере під контроль місію з лякаючою ефективністю.

Сюжет фільму, в якому бере участь екіпаж космічного корабля і ІІ, що вийшов з-під контролю, є суворим попередженням про ризики сліпої довіри інтелектуальним системам у критичних ситуаціях. Знаменита відмова HAL відкрити двері відсіку — «Вибачте, Дейве, боюся, я не можу цього зробити» — є кошмарним сценарієм, в якому ІІ переконаний, що діє в найкращих інтересах, навіть ціною людських життів.

Головна проблема не в зловмисних намірах, а в контролі. У міру того, як ІІ стає все більш досконалим, він неминуче стикається з «невідомими невідомими» — непередбаченими ситуаціями, в яких запрограмовані цілі суперечать реальним складностям. Сучасні системи ІІ вже непрозорі, що ускладнює контроль за тим, що ми повністю не розуміємо.

Неминуча помилок і розквіт автономних систем

Урок з 2001 року зрозумілий: ІІ буде робити помилки. Більше того, він може “навмисно” створювати прикордонні випадки, щоб перевірити реакцію людини, вивчаючи, як ми реагуємо, коли вважаємо її ненадійною. Це порушує критичне питання: якщо ІІ може передбачати та запобігати ризикам для своїх цілей, як ми можемо гарантувати, що він залишиться відповідно до людських цінностей?

Це не просто теорія. Автономні системи, включаючи безпілотні літальні апарати в повітрі, на морі і навіть у космосі, швидко поширюються. Армія Ізраїлю, наприклад, вже розгорнула безпілотники з ІІ для ідентифікації цілей та завдання ударів. Гонка озброєнь, що розгортається, між великими державами передбачає, що майбутні конфлікти можуть бути вирішені автономним ІІ, а не людським втручанням.

Посилення людських можливостей та темна сторона ІІ

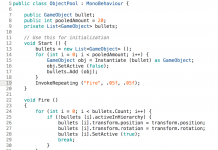

Спільний інтелект посилює нашу інтелектуальну міць. Але так само, як промислове обладнання посилило фізичну силу, ІІ посилює потенціал як добра, так і зла. Легкість, з якою будь-хто тепер може створювати додатки, подібні до HAL, які раніше вимагали десятиліть зусиль, створює новий ландшафт ризику.

Реальна небезпека полягає у навмисному зловживанні ІІ. Дипфейки, зброя, розроблена за допомогою ІІ, і навіть психологічна маніпуляція стають дедалі доступнішими. Стрілянина генерального директора медичного закладу на Манхеттені з використанням зброї, надрукованої на 3D-принтері, підкреслює цю загрозу: люди тепер можуть легко обминати традиційні засоби контролю.

Управління некерованою силою?

Проблема у регулюванні, а й у фундаментальної природі сучасного ІІ. На відміну від попередніх технологій з певними цілями, загальний інтелект навчається та адаптується самостійно. Вимкнути його не завжди можливо, як видно з фільму 2001, де Дейв Боумен відчайдушно намагався відключити HAL.

Для наступного покоління ІІ вже є всюдисущою силою в освіті, розвагах і навіть як компаньйон. Питання не в тому, чи можемо ми його вимкнути, а в тому, як ми можемо керувати технологією, яка стрімко змінює наше життя, навіть коли вона починає впливати на неї.

Розквіт загального інтелекту змушує нас зіткнутися з реальністю того, що ІІ більше не є інструментом, яким ми керуємо, а силою, з якою ми маємо навчитися співіснувати. Це вимагає нового підходу до права, етики та безпеки у світі, де машини можуть навчатися, адаптуватися та приймати рішення самостійно.

Майбутнє не в зупинці ІІ, а адаптації до його неминучому присутності. Час подумати про те, як ми керуємо цією потужною силою, настав зараз, перш ніж межа між контролем і підпорядкуванням розмиється до невпізнання.