Anthropic пояснює феномен «AI-шринкфляції»: як технічні правки знизили продуктивність Claude

Протягом кількох тижнів співтовариство розробників ІІ б’є на сполох через відчутне зниження інтелектуальних здібностей флагманських моделей Anthropic. Користувачі на таких платформах, як GitHub, X і Reddit, повідомляли про явище, яке вони охрестили “AI-шринкфляцією” (AI shrinkflation) – тренді, при якому Claude ставав менш здатним до складного міркування, частіше припускався помилок і почав менш ефективно витрачати токени.

Хоча споконвічно Anthropic заперечувала заяви про навмисне «заниження характеристик» (nerfing) моделі для управління навантаженням на сервери, тепер компанія опублікувала технічний звіт за підсумками розслідування. З’ясувалося, що, хоча основні ваги нейромережі залишилися незмінними, три конкретні коригування в “оболонці” (harness) – програмних шарах, що оточують модель, – ненавмисно підірвали її ефективність.

Докази деградації

Невдоволення користувачів не було просто суб’єктивною думкою; воно підкріплювалося серйозними технічними даними. На початку квітня 2026 року дискусія про «обдурення» Claude набула широкого суспільного резонансу завдяки кільком ключовим висновкам:

- Масштабні аудити: Стелла Лоренцо, старший директор групи ІІ в AMD, провела аудит понад 6 800 сесій Claude Code та 234 000 викликів інструментів. Її дані вказали на різке зниження глибини міркувань: модель часто зациклювалася на повтореннях або вибирала найпростіший варіант рішення замість найточнішого.

- Падіння показників бенчмарків: Стороннє тестування, проведене BridgeMind, показало значний удар Claude Opus 4.6: показники точності впали з 83,3% до 68,3%, через що модель опустилася в галузевому рейтингу з другого на десяте місце.

- Неефективність ресурсів: Користувачі повідомляли, що ліміти використання вичерпуються набагато швидше, ніж зазвичай. Це породило підозри, що модель стала більш «багатослівною» або менш ефективною в обробці інформації.

Причини події: три технічні винуватці

Anthropic пояснила, що “мозок” ІІ (ваги моделі) не змінювався. Натомість проблеми виникли через зміни в інтерфейсі користувача та інструкціях, що направляють поведінку моделі:

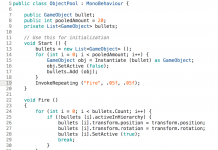

1. Зниження інтенсивності міркувань

Щоб вирішити проблему затримок інтерфейсу (коли екран здавався “завислим”, поки модель “думала”), Anthropic знизила рівень інтенсивності міркувань за умовчанням з високого до середнього для Claude Code. Це зробило інтерфейс більш чуйним, але позбавило модель обчислювальної глибини, яка потрібна на складних інженерних завдань.

2. Баг у логіці кешування

Оновлення від 26 березня, призначене для оптимізації пам’яті шляхом видалення застарілих даних про ходax думок з неактивних сесій, містило критичну помилку. Замість того, щоб очищати старі дані один раз після години бездіяльності, баг прав «короткострокову пам’ять» моделі при кожній подальшій взаємодії. Це призвело до того, що Claude стала «забудькуватою» і схильною до повторів.

3. Обмеження на багатослівність

У спробі зробити відповіді більш лаконічними, Anthropic запровадила нові інструкції, що обмежують обсяг тексту між викликами інструментів та фінальними відповідями. Ця установка на «стислість» дала зворотний ефект: оцінки показали зниження якості кодингу на 3%, так як моделі було важко висловлювати складну логіку в рамках строгих обмежень за кількістю слів.

Відновлення довіри та майбутні заходи захисту

Наслідки цих помилок торкнулися Claude Code CLI, Claude Agent SDK та Claude Cowork, хоча основний Claude API залишився недоторканим. Щоб виправити ситуацію та запобігти повторенню подібних випадків, Anthropic впроваджує низку структурних змін:

- Розширене «внутрішнє тестування» (dogfooding): Більшість співробітників компанії тепер буде зобов’язано використовувати ті ж публічні зборки, що й клієнти, щоб виявляти регресії до їхнього виходу на ринок.

- Суворе тестування: Компанія впроваджує покращені набори інструментів для оцінки того, як кожна незначна зміна в «системному промпті» впливає на загальний інтелект моделі.

- Компенсація передплатникам: Визнаючи розчарування користувачів та марно витрачені токени, Anthropic скинула ліміти використання для всіх передплатників станом на 23 квітня.

«Ми ніколи не будемо навмисно погіршувати наші моделі», – заявили в Anthropic, підкресливши, що їхня мета – забезпечити відповідність досвіду користувача високим стандартам їх базових технологій.

Висновок: Anthropic встановила, що недавнє падіння продуктивності було викликане спробами оптимізації програмного шару, а не змінами в ІІ. Відкотив ці зміни і посиливши внутрішнє тестування, компанія прагне відновити репутацію Claude як інструменту з найвищим рівнем логічного мислення.