В традиционной разработке ПО тестирование прямолинейно: Вход А + Функция Б всегда равны Выходу В. Этот детерминизм позволяет разработчикам создавать надежные и предсказуемые системы.

Генеративный ИИ нарушает это правило. Поскольку большие языковые модели (LLM) являются стохастическими — то есть вероятностными и непредсказуемыми — один и тот же запрос может давать разные результаты в разные дни. Для крупных компаний, где «галлюцинация» — это не просто забавная особенность, а серьезный риск нарушения комплаенса, полагаться на «проверку вайбом» (субъективное ручное тестирование) — значит идти по пути катастрофы.

Чтобы выпускать готовые к эксплуатации ИИ-продукты, инженеры должны отказаться от интуиции в пользу структурированного стека оценки ИИ (AI Evaluation Stack).

Двухуровневая таксономия оценки ИИ

Профессиональный конвейер оценки не должен относиться ко всем ошибкам одинаково. Вместо этого проверки следует разделить на два различных архитектурных уровня, чтобы максимизировать эффективность и минимизировать затраты.

Уровень 1: Детерминированные утверждения (Шлюз «быстрого отказа»)

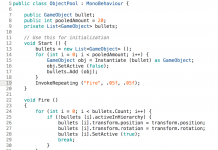

Многие сбои ИИ на самом деле не являются «галлюцинациями» в поэтическом смысле; это простые структурные ошибки. Детерминированные утверждения используют традиционный код и регулярные выражения для проверки синтаксиса и маршрутизации ответа.

Вместо того чтобы спрашивать, является ли ответ «полезным», эти проверки задают бинарные технические вопросы:

– Выдала ли модель правильную схему JSON?

– Вызвала ли она нужный инструмент с требуемыми аргументами?

– Соответствует ли формат предоставленного адреса электронной почты или ID?

Почему это важно: Такие проверки обходятся дешево и выполняются мгновенно. Внедряя логику «быстрого отказа» (fail-fast), вы можете мгновенно отклонить некорректный ответ, не тратя дорогостоящие ресурсы на глубокий семантический анализ.

Уровень 2: Проверки на основе моделей (Подход «LLM-судья»)

Как только ответ проходит структурную проверку, он должен пройти проверку на нюансы. Поскольку программный код не может легко определить, является ли ответ «вежливым» или «конструктивным», инженеры используют паттерн LLM-as-a-Judge (языковая модель в роли судьи).

Чтобы сделать этот процесс масштабируемым и надежным, «Судье» требуются три компонента:

1. Модель с превосходными способностями к рассуждению: Судья должен быть мощнее рабочей модели (например, использование передовой модели вроде GPT-4o для оценки более компактной и быстрой модели Llama).

2. Строгая рубрика: Расплывчатые инструкции ведут к зашумленным данным. Рубрика должна определять конкретные градации оценки (например, Оценка 1: Неуместный отказ; Оценка 3: Конструктивный и контекстуально точный ответ ).

3. Эталонные данные (Golden Outputs): Судья работает лучше всего, когда у него есть «ключ к ответам» — проверенный человеком ответ, с которым нужно сравнивать результат работы модели.

Двойная архитектура конвейера: Offline vs. Online

Полная система требует двух взаимодополняющих рабочих процессов: один для предотвращения багов до того, как они попадут к пользователям, и другой для их обнаружения в процессе эксплуатации.

1. Offline-конвейер (Регрессионное тестирование)

Offline-конвейер — это ваша страховочная сетка. Он выступает в роли контролера в процессе разработки, подобно компилятору в традиционном программировании.

- «Золотой» набор данных (Golden Dataset): Инженеры создают контролируемый репозиторий из 200–500 «золотых» тестовых сценариев. Они представляют весь спектр ожидаемого поведения пользователей, включая «счастливые пути» и состязательные пограничные случаи (например, попытки взлома/jailbreak).

- Композитная оценка: Каждому тесту присваивается взвешенный балл. Например, за задачу «Отправить письмо» может быть начислено 6 баллов за структурную корректность (Уровень 1) и 4 балла за семантическое качество (Уровень 2).

- Порог прохождения: Устанавливается проходной балл (например, 95%). Если обновление модели приводит к падению процента успешных тестов, развертывание автоматически блокируется.

2. Online-конвейер (Телеметрия в реальном времени)

Online-конвейер отслеживает «живой» продукт, чтобы обнаружить дрейф модели — явление, при котором производительность модели снижается со временем из-за изменений в API провайдеров или сдвигов в паттернах поведения пользователей.

Ключевые сигналы для мониторинга включают:

* Явные сигналы: Пользовательские лайки/дизлайки или письменные отзывы.

* Неявные сигналы: Высокая частота повторных запросов (пользователи спрашивают одно и то же снова), высокая частота извинений («Извините, я не могу…») или высокий процент отказов.

* Асинхронное судейство: Чтобы не замедлять работу пользователя, модель-«Судья» может в фоновом режиме анализировать небольшой процент (например, 5%) реального трафика для формирования непрерывного дашборда качества.

Маховик: Создание цикла непрерывного улучшения

Оценка — это не задача из разряда «настроил и забыл». По мере изменения поведения пользователей (например, когда HR-бот сталкивается с новыми корпоративными правилами) старый «Золотой набор данных» устаревает. Это называется дрейфом концепции (concept drift).

Чтобы бороться с этим, высокоэффективные команды внедряют маховик обратной связи :

1. Фиксация сбоя в продакшене (через дизлайк или высокую частоту повторных запросов).

2. Сортировка сессии для последующего анализа человеком.

3. Анализ первопричины (например, отсутствие источника знаний).

4. Дополнение Offline-золотого набора этим новым, исправленным примером.

5. Регрессионное тестирование модели, чтобы убедиться, что исправление работает и ничего не сломало.

Заключение

В эпоху генеративного ИИ статус «готово» больше не означает, что код написан; это означает, что модель постоянно отслеживается, оценивается и совершенствуется в условиях постоянно меняющихся намерений человека.