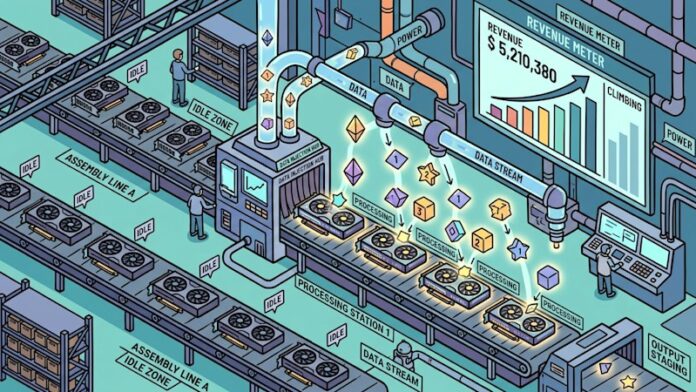

Сучасний ландшафт ІІ характеризується періодами втраченого потенціалу. GPU-кластери, основа машинного навчання, часто простоюють між навчальними ітераціями або при зміні робочого навантаження, проте оператори продовжують нести витрати на електроенергію та охолодження. FriendliAI, заснована дослідником, що стоїть за широко поширеною технікою безперервного пакетування, запускає InferenceSense – платформу, розроблену для монетизації раніше втрачених потужностей. Замість того щоб дозволяти потужному устаткуванню залишатися неактивним, InferenceSense дозволяє операторам неоклаудів продавати доступ до невикористаних GPU режим реального часу.

Основна Проблема: Неефективне Використання Ресурсів

GPU-кластери за своєю природою є неефективними. Навчальні завдання завершуються, попит вагається, а дороге обладнання залишається неактивним, тоді як фіксовані витрати накопичуються. Існують спотові GPU-ринки, але вони вимагають від хмарних провайдерів здачі в оренду потужностей, залишаючи технічний тягар та оптимізацію стека інференсу на кінцевого користувача. Підхід FriendliAI принципово відрізняється: він дозволяє операторам безпосередньо монетизувати GPU, що простоюють, запускаючи робочі навантаження інференсу. Це обходить традиційні моделі оренди і відкриває нове джерело доходу.

Безперервне Пакетне Обробка: Основа Ефективності

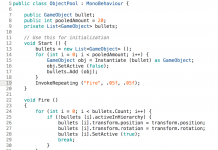

Технологія, що лежить в основі InferenceSense, є результатом роботи Бен-Гон Чуна, професора Сеульського національного університету, чиї дослідження в галузі безперервного пакетного процесу провели революцію в ІІ-інференсі. Його стаття 2020 року Orca представила динамічний метод обробки, який уникає очікування повних пакетів перед виконанням запитів. Ця техніка, яка є галузевим стандартом і реалізована в популярному движку інференсу vLLM, максимізує пропускну здатність.

Основна інновація Чуна тепер застосовується для вирішення проблеми неповної утилізації GPU. Мета полягає в тому, щоб заповнити неактивні цикли платними робочими навантаженнями інференсу, оптимізуючи пропускну спроможність токенів та ділячись доходом з оператором.

Як працює InferenceSense: Безшовна Інтеграція

InferenceSense безпосередньо інтегрується з існуючою інфраструктурою Kubernetes, яку більшість операторів неоклаудів вже використовують для оркестрації ресурсів. Оператори виділяють GPU-пули в кластер, керований FriendliAI, визначаючи доступність та умови скасування. Коли GPU не використовуються, платформа запускає ізольовані контейнери для обслуговування робочих навантажень інференсу для моделей з відкритою вагою, таких як DeepSeek, Qwen та Kimi.

Процес розроблений таким чином, щоб бути безшовним: коли планувальник оператора потребує апаратного забезпечення, робочі навантаження інференсу перериваються протягом кількох секунд. FriendliAI обробляє агрегування попиту через прямих клієнтів та агрегаторів, таких як OpenRouter, забезпечуючи постійний потік завдань. Панелі керування в реальному часі надають операторам прозорість щодо використання моделей, обробки токенів та отриманого доходу.

Пропускна Здатність Токенов vs. Сира Потужність: Ключова Відмінність

Традиційні спотові GPU-ринки монетизують сиру потужність. InferenceSense, однак, монетизує пропускну спроможність токенів, тобто оператори заробляють на основі фактичної обробки ІІ, а не просто на неактивному устаткуванні. FriendliAI стверджує, що її двигун забезпечує пропускну здатність у два-три рази вище, ніж стандартні розгортання vLLM, завдяки спеціально розробленому стеку на C++ та пропрієтарним GPU-ядрам, які обходять бібліотеку Nvidia cuDNN.

Ця підвищена ефективність безпосередньо перетворюється на вищий прибуток за невикористаний цикл. Оператори можуть заробляти більше, заповнюючи неактивний час інфересом, ніж здаючи в оренду сиру потужність.

Наслідки для Інженерів ІІ та Оптимізації Витрат

Для інженерів ІІ поява платформ, таких як InferenceSense, може змінити економіку інференсу. Оскільки неоклауди монетизують потужності, що не використовуються, у них може з’явитися стимул знижувати ціни на токени, щоб залишатися конкурентоспроможними. Хоча це рання тенденція, вона може призвести до зниження цін на API для популярних моделей, таких як DeepSeek і Qwen, протягом наступного року.

Головний висновок у тому, що інфраструктурні рішення еволюціонують. Неоклауди стають більш привабливими не тільки через ціну та доступність, але й через їх потенціал використовувати невикористовувані потужності та передавати цю економію клієнтам.

Зрештою, InferenceSense є зміною парадигми у використанні GPU. Перетворюючи порожні цикли на прибуток, FriendliAI перебудовує економіку ІІ-інференсу.